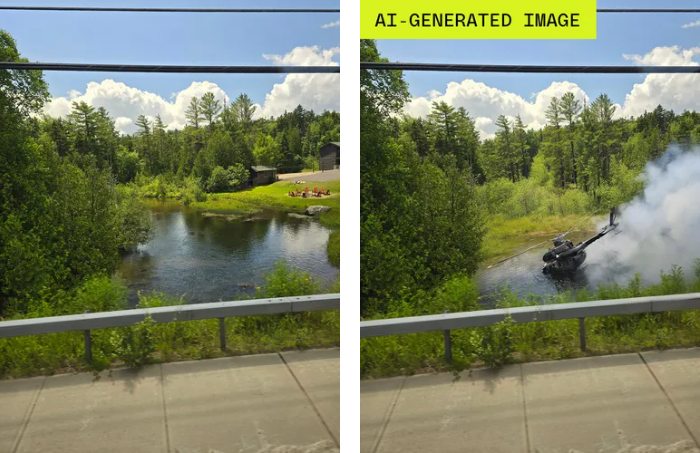

从一座旧砖楼侧面爆炸的场景,到城市十字路口一辆摔坏的自行车,再到外卖盒子里的蟑螂——使用 Pixel 9 的 Magic Editor 中的 Reimagine 工具,只需要不到 10 秒钟就能创建这些图像。它们清晰、色彩鲜明、画质极高。没有可疑的背景模糊,也没有显眼的“第六根手指”。这些照片极具欺骗性,但它们全都是彻头彻尾的伪造。

从本周起,任何购买 Pixel 9——谷歌最新旗舰手机的人,都会拥有这个内置的用户界面,能够轻松创建顶级假象。这几乎注定会成为常态,因为类似功能已经在竞争设备上出现,并将在不久的将来推广到其他设备。当一部智能手机“恰好能用”时,通常是一件好事;但在这里,这恰恰是问题的根源。

自摄影问世以来,它就一直被用作制造欺骗的工具。(比如维多利亚时代的灵异照片、臭名昭著的尼斯湖水怪照片,或斯大林对被清洗同志的照片篡改。)然而,如果说照片从未被视为可靠的证据,那就显得不诚实了。所有在2024年阅读这篇文章的人,都成长于一个默认情况下照片被视为真实再现的时代。无论是布景加电影特效的场景、数字照片处理,还是近来的深度伪造——这些都可能是需要考虑的欺骗手段,但在当时的可能性范围内,它们属于极少数。要破坏人们对照片的直觉信任,需要专业的知识和工具。伪造是例外,而非常态。

如果我提到天安门广场,你很可能会想起我脑海中的同一张照片。这种情况同样适用于阿布格莱布监狱事件或“凝固汽油弹女孩”那张照片。这些影像定义了战争和革命,以一种难以完全表达的方式概括了真相。我们无需解释这些照片为何重要、为何具有转折性、为何我们如此重视它们。我们对摄影的信任如此深厚,以至于当我们花时间讨论图像的真实性时,更重要的是强调:照片有时可能是伪造的这一点。

然而,这一切即将发生颠覆——我们对照片的默认假设将转变为它是伪造的,因为如今制作逼真且可信的假照片已经变得轻而易举。我们还未做好准备去面对这一变化所带来的后果。

当今世界上没有任何人曾经生活在一个照片不是社会共识核心的世界中——从我们来到这个世界的那一刻起,照片就是证明某事发生的有力证据。想一想,过去照片的真实性假设是如何验证你经历的真相的:租来的车上已经存在的刮痕、天花板的漏水、包裹的到达、外卖盒子里真实存在的蟑螂,而不是AI生成的版本。当野火逼近你的居住区时,你如何向朋友和熟人传达外面烟雾的浓度?

直到现在,质疑照片真实性的人大多承担着举证的责任。平地学者与社会共识格格不入,不是因为他们不了解天体物理学——毕竟,我们中有多少人真正理解天体物理学?——而是因为他们必须进行一系列越来越复杂的辩解,来说明为什么某些照片和视频不是真实的。他们必须编造一个庞大的国家阴谋论,来解释源源不断的卫星照片如何捕捉到地球的弯曲。他们必须为1969年的登月任务设计一个摄影棚。

我们一直认为举证责任在他们身上。在Pixel 9时代,或许我们最好开始复习一下天体物理学了。

总体而言,这些 AI 工具生成的普通图像本身大多是无害的——比如背景中的一棵额外的树、一家披萨店里的鳄鱼,或是一只猫身上的搞笑服装。然而,当这些图像积累起来时,便彻底颠覆了我们对照片概念的处理方式,而这本身就带来了巨大的影响。举个例子,过去十年里,在美国,由于警方暴行的模糊视频引发了极大的社会动荡。当当局试图掩盖或隐藏真相时,这些视频却揭示了事实。

如今,随着AI生成图像的泛滥,我们不得不重新思考照片的真实性及其作为证据的可靠性。在一个图像可以轻易被操纵的时代,我们如何确定这些视频和照片的真实性?这不仅挑战了我们的判断力,也可能对社会的正义和透明性产生深远影响。

特朗普主义者不断高呼的“假新闻!”预示了这个不受约束的虚假信息时代的开始。在这个时代,真相的影响将被谎言的洪流所淹没。下一次阿布格莱布监狱事件将会被淹没在AI生成的战争罪行图像的海洋中;下一个乔治·弗洛伊德事件可能会被忽视,无法得到正义的伸张。

你已经可以看到未来的轮廓。在凯尔·里滕豪斯的审判中,辩方声称苹果的“捏合缩放”功能会操纵照片,成功说服法官将举证责任转嫁给检方,要求其证明放大后的iPhone视频未经过AI操控。最近,唐纳德·特朗普错误地声称一张卡玛拉·哈里斯集会的照片是AI生成的——这一说法之所以能够提出,仅仅因为人们可能会相信它。

即使在AI出现之前,媒体工作者已经处于一种防御姿态,不断审查每张图像的细节和来源,验证其背景是否具有误导性或是否经过了照片处理。毕竟,每次重大新闻事件都会伴随着一波虚假信息。然而,即将到来的范式转变涉及的远不止这种被称为“数字素养”的持续怀疑。

谷歌非常清楚自己正在对照片这一“机构”做些什么——在接受《连线》杂志采访时,Pixel相机的产品经理将这一编辑工具描述为“帮助你创造一个与你记忆中的时刻一致、与更大背景相符的场景,尽管它可能并不符合某个特定瞬间的真实情况。”在这种观念中,照片不再是对人类易错记忆的补充,而是其镜像。而当照片变得只不过是人类幻觉的具象化时,最荒唐的事情也可能会在法庭上演变成关于证人信誉和佐证证据存在与否的争斗。

这种社会共识的瓦解早在Pixel 9问世之前就已经开始,而且也不仅仅是由Pixel 9推动的。然而,这款手机的新AI功能值得注意的原因不仅在于其入门门槛如此之低,更在于我们所遇到的防护措施竟然如此薄弱。行业提议的AI图像水印标准正陷入一如既往的标准制定僵局,而当《The Verge》试用Pixel 9的Magic Editor时,谷歌广受宣传的AI水印系统却不见踪影。使用Reimagine工具修改的照片仅仅添加了一行可移除的元数据。

谷歌告诉我们,Pixel Studio的输出——一种更接近DALL-E的纯提示生成器——将被标记上SynthID水印;讽刺的是,我们发现Magic Editor中Reimagine工具的功能更加令人不安,因为它修改的是现有照片。相比之下,这种修改照片的能力让人更加担忧,因为它使得原本作为真实记录的照片变得难以信任,而这种情况的后果可能远比生成全新图像更为严重。

谷歌声称,Pixel 9不会成为一个不受限制的“虚假信息制造工厂”,但在实质性保障方面却显得相当薄弱。谷歌通讯经理Alex Moriconi在发给《The Verge》的一封电子邮件中表示:“我们设计生成式AI工具时,会尊重用户提示的意图,这意味着当用户指示这样做时,它们可能会生成令人反感的内容。”他补充道,“但这并不意味着任何内容都可以。我们对允许和不允许的内容有明确的政策和服务条款,并设立了防护措施以防止滥用。有时,一些提示可能会挑战这些工具的防护措施,我们仍然致力于不断增强和完善已有的保护措施。”

这些政策大体上符合预期——例如,你不能使用谷歌服务来协助犯罪或煽动暴力。有些提示会返回一个通用错误信息:“Magic Editor无法完成此编辑。请尝试输入其他内容。”(然而,如你所见,本篇文章中依然有一些令人担忧的提示成功生成了结果。)但归根结底,标准的内容审核无法挽救照片作为真相象征的逐渐衰亡。

我们曾短暂地生活在一个照片是通向现实的捷径的时代,它让我们了解事物,捕捉确凿证据。照片是我们理解周围世界的极其有用的工具。而现在,我们正全速跳入一个现实变得更加难以捉摸的未来。消失的亚历山大图书馆可能已经可以装进我的Nintendo Switch的microSD卡中,而科技的前沿竟然是一部带有“撒谎”功能的手持电话,作为一个有趣的小增值功能。